Почему сайт плохо индексируется, что такое индексация и какие существуют методы ускорения

Проблема индексации посадочных страниц — одна из основных, с которой сталкивается почти каждый владелец сайта. Индексация – добавление информации о вашем сайте в базу данных поисковых систем. Страницы, которых нет в индексе, пользователи не смогут найти, следовательно — трафика на них не будет.

Поисковые системы сканируют сайты в интернете на предмет качественных документов, удовлетворяющих спрос пользователей. Поисковики заинтересованы, чтобы база сайтов была максимально полной и актуальной, поэтому регулярно сканируют все, известные им, сайты в поисках нового контента. Есть целые сайты и/или отдельные документы, которые редко сканируются поисковыми системами либо же не сканируются вовсе. В статье мы разберем основные моменты, влияющие на скорость индексации документов.

Причины плохой индексации сайта

Чтобы разобраться, почему сайт плохо индексируется, нужно определиться с понятиями «краулинг» и «краулинговый бюджет».

Краулинг — это процесс сканирования страниц ботами поисковых систем. Основная цель краулинга — найти максимальное количество полезных и актуальных документов.

Краулинговый бюджет — это лимит, который выделяется каждому сайту на сканирование. Другими словами это ограничение числа страниц, которые поисковый робот может просканировать в заданный промежуток времени. Краулинговый бюджет рассчитывается для каждого сайта отдельно, исходя из частоты обновления контента, качества ресурса, ответа сервера, размера страниц и других параметров.

Логично, если на сайте 10 страниц и ничего не меняется годами – роботы поисковых систем не будут сканировать такие сайты часто. Нет смысла тратить ресурсы на эту задачу.

Исходя из понятия «краулинга» и нашего SEO-опыта рассмотрим ошибки и способы их исправления.

Как узнать, что сайт плохо индексируется?

Сайт или страница редко индексируется, если дата сохраненной копии (кеша) старше двух недель. Проверяем дату кеша документа в Google через оператор cache: cache:inweb.ua

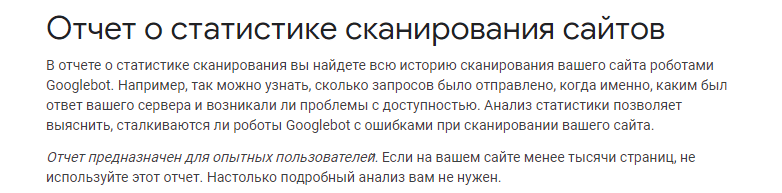

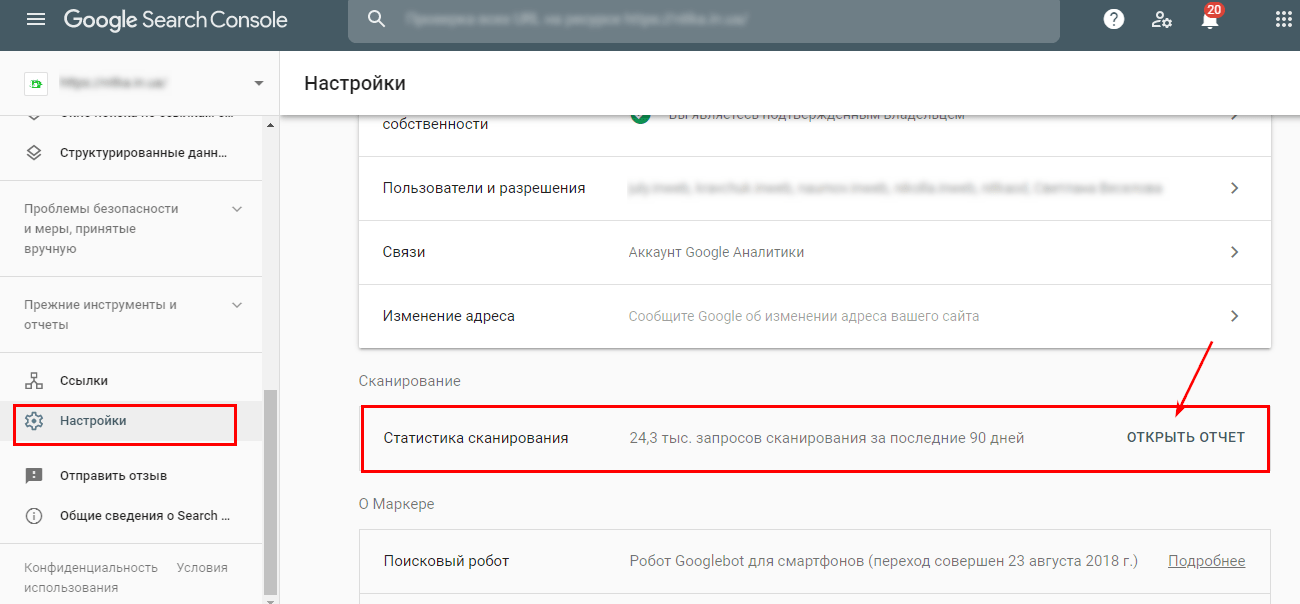

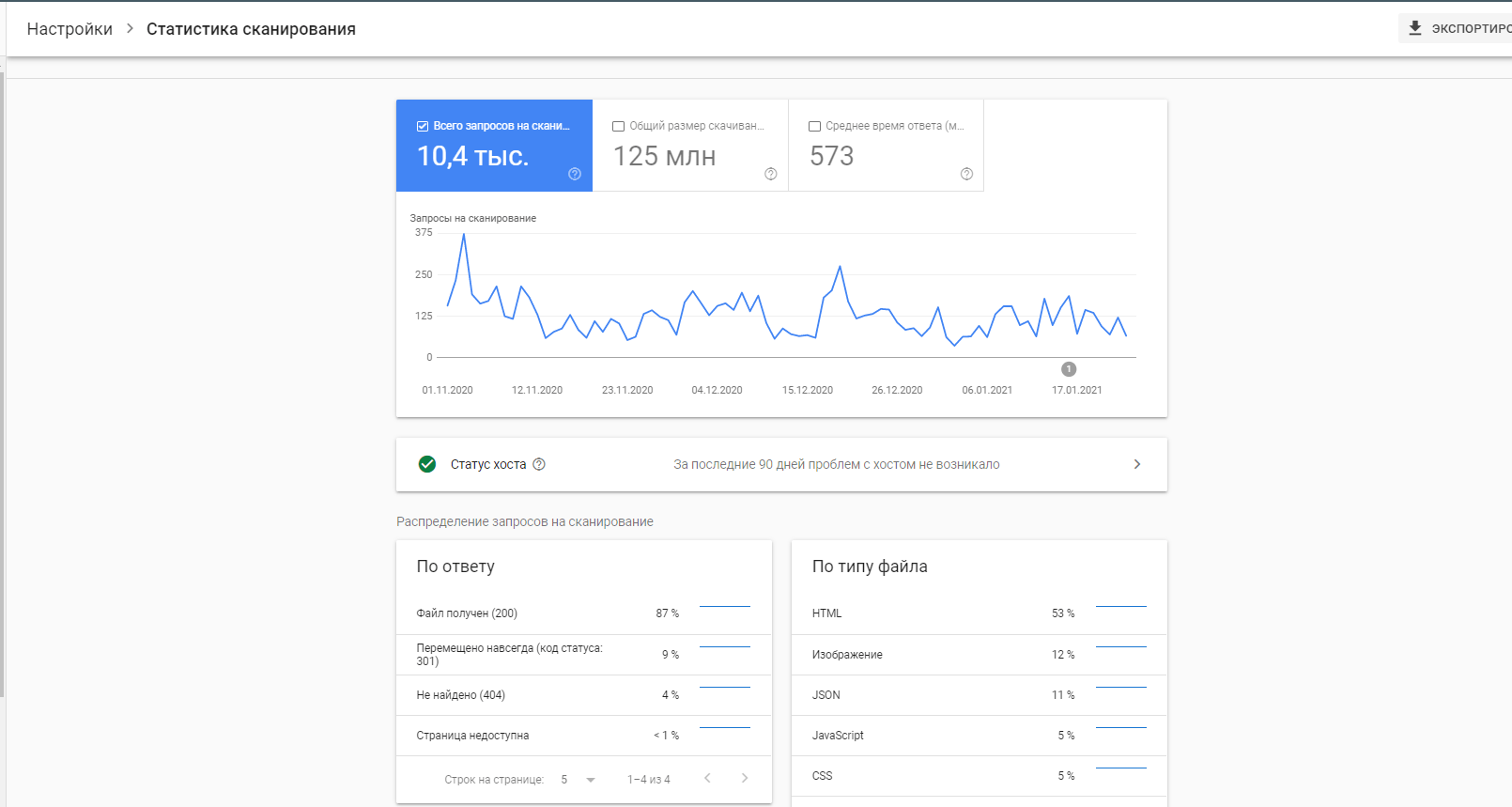

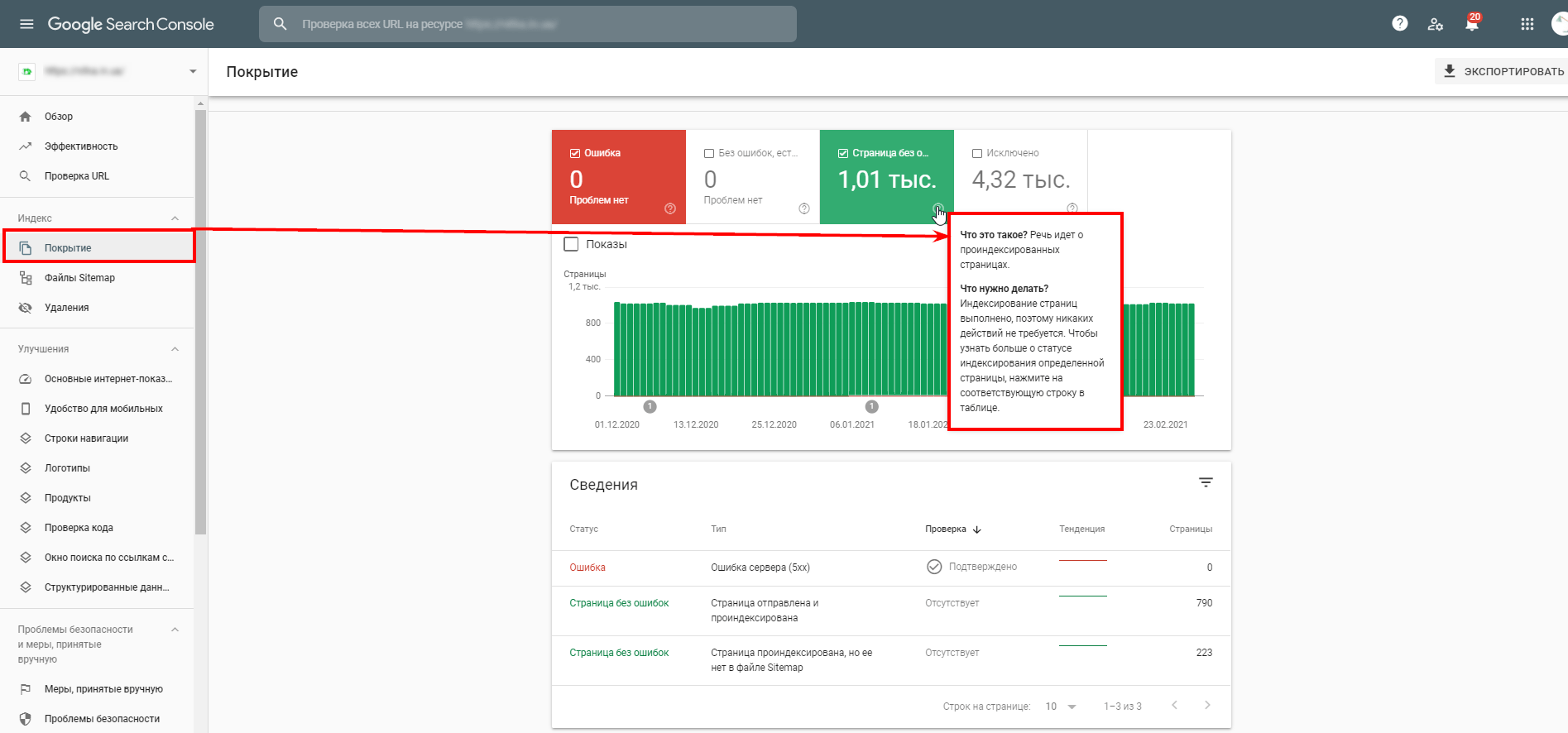

Если дата кэшированной копии старше месяца – с индексацией серьезные проблемы. Результаты сканирования вашего сайта поисковыми системами можно посмотреть в специальных отчетах Google. Для поисковой системы Google данный отчет доступен в сервисе Search Console. Вот что пишет Google о своем отчете:

Пример отчета в Google Search Console:

Чаще всего, проблема краулинга касается только очень больших сайтов. Если ваш сайт имеет до 1000 страниц и они индексируются раз в месяц или реже, то основная причина плохой индексации где-то на самих страницах. Рассмотрим основные ошибки, влияющие на сканирование и индексирование страниц.

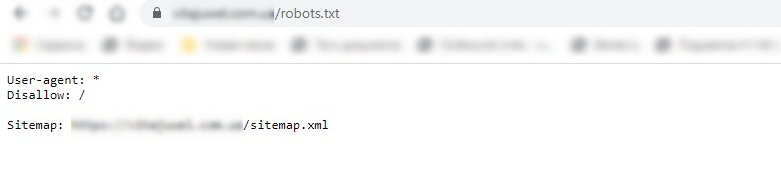

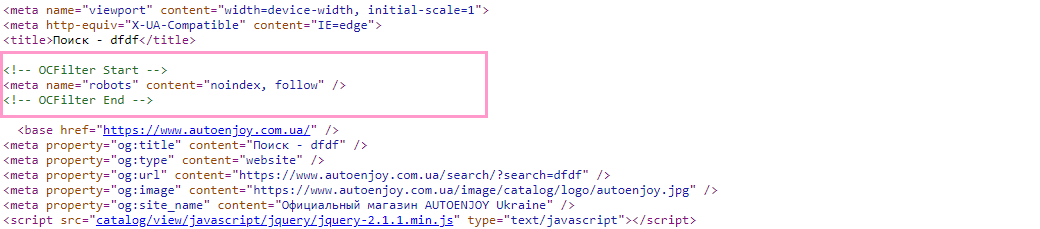

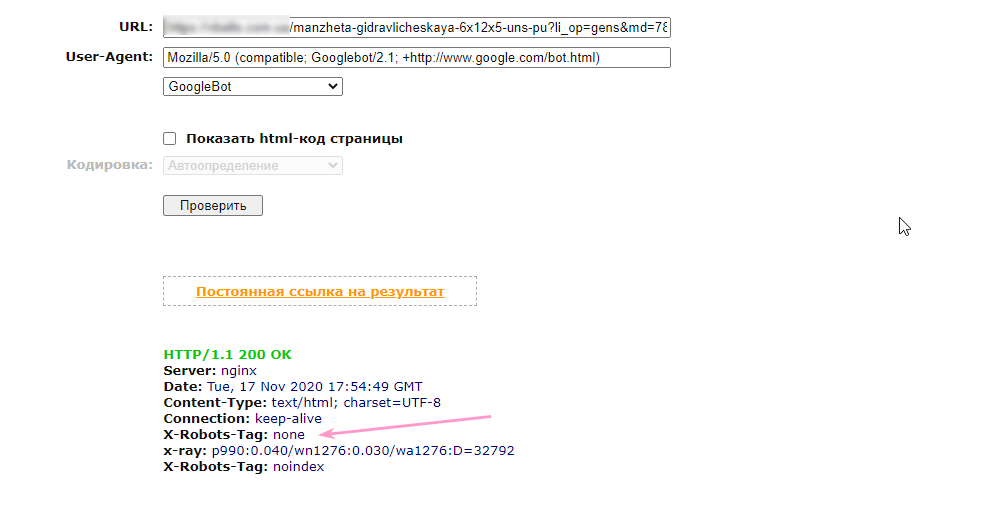

- Закрытие сайта или отдельных страниц в файле robots.txt, noindex, X-Robots tag. Отдельные страницы или сайт в целом могут быть закрытыми от индексации всех поисковых систем или какой-то конкретной. В таком случае сайт не будет сканироваться, нужные страницы попадать в индекс, итог — вы не сможете ранжироваться в поиске.Пример закрытого сайта от индексации в файле robots.txt:

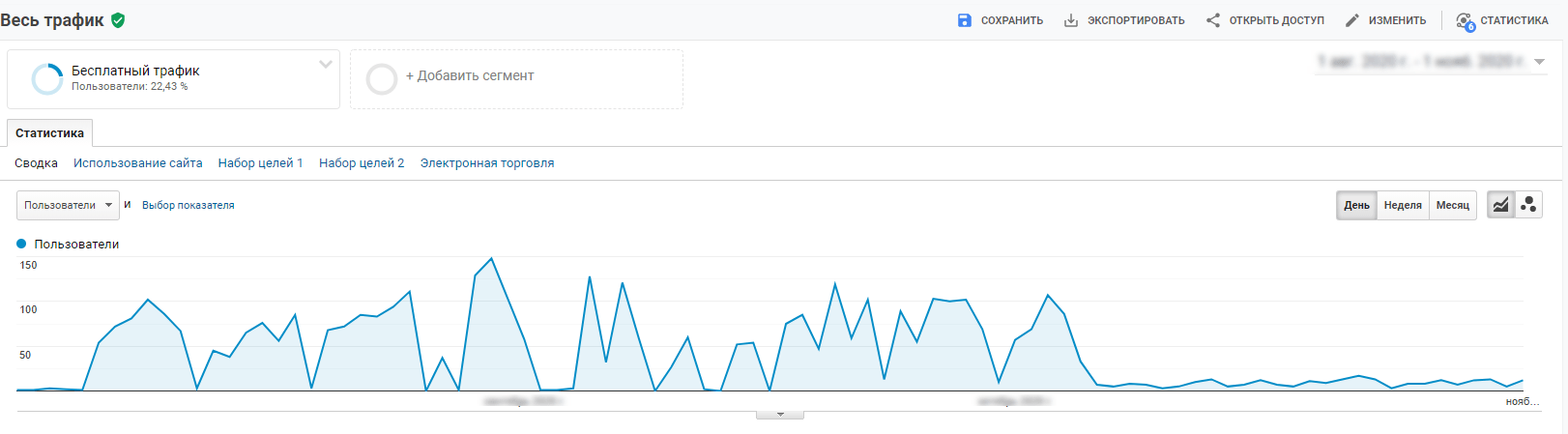

- Фильтр, санкции от поисковых системЧтобы давать пользователям качественный контент, Google создал алгоритмы для вычисления качественных сайтов. Если трафик не растет, возможно на сайт были наложены санкции (проверить можно в Google Analytics, Search Console).

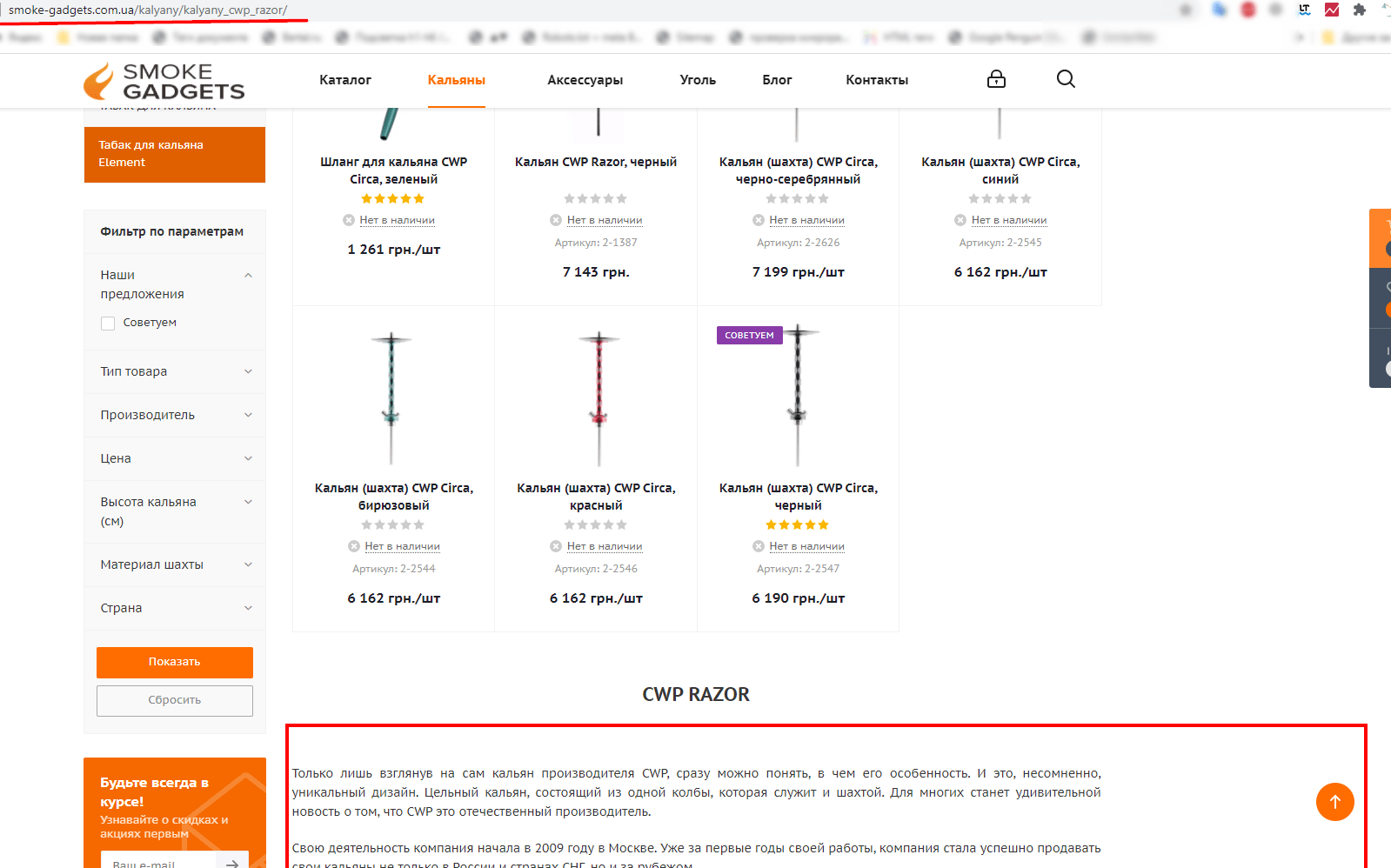

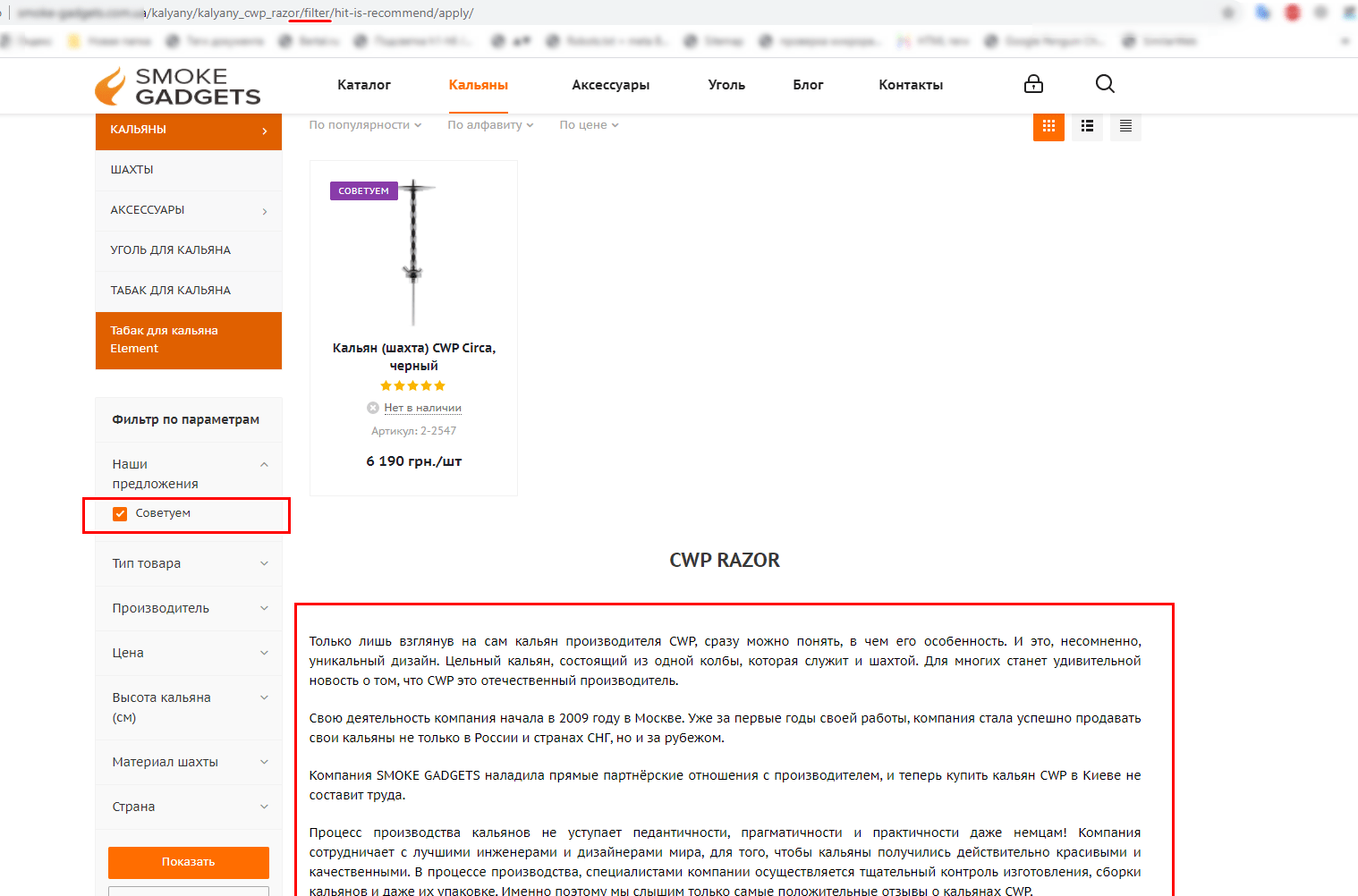

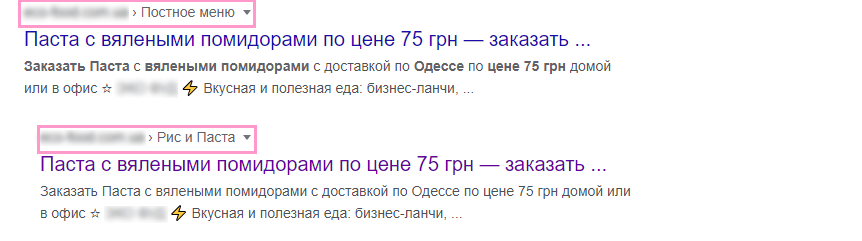

- Некачественный контент (неуникальный, неинформативный, дублированный) и дубли страниц. Дубли страниц – это страницы, оптимизированные под одинаковые запросы, но на разных url-адресах. Общий объем сайта увеличивается за счет таких дублей, боты, в свою очередь, тратят больше времени на индексацию этих «мусорных» страниц, тем самым неэффективно растрачивая краулинговый бюджет сайта, а качественные страницы могут вовсе не попасть в индекс.Возвращаемся в понятие «краулинговый бюджет», где поисковые роботы затрачивают на сканирование сайта n времени. Если робот «видит», что контент регулярно повторяется, индексация будет проводиться существенно дольше или может вовсе прекратиться. Поисковик посчитает контент некачественным, а значит не увидит смысла его вообще или часто сканировать.Дублироваться могут не только страницы, но и контент. Дубли контента — повторяющиеся материалы на разных страницах сайта (часто встречаются на страницах пагинации, фильтров или сортировках). Вот пример дублированного контента на страницах, не закрытых от индексации: http://smoke-gadgets.com.ua/kalyany/kalyany_cwp_razor/filter/hit-is-recommend/apply/

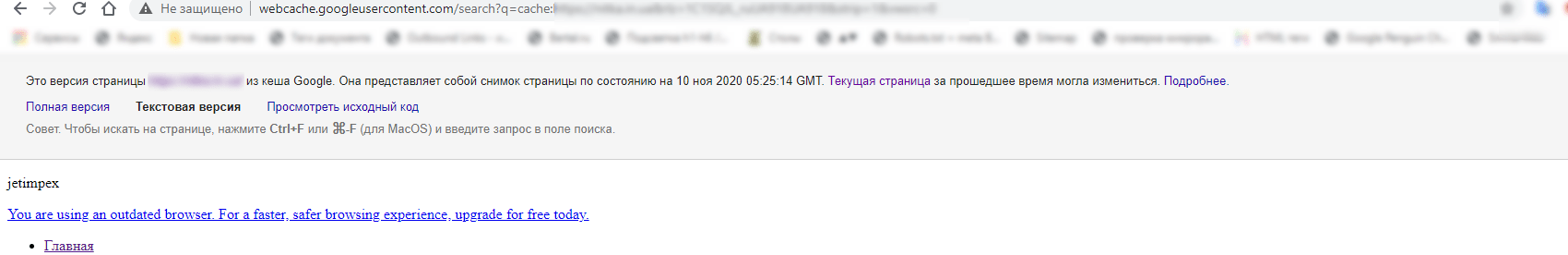

- Ошибки в коде сайта. Поисковый бот должен обработать HTML-код. Если страницы сделаны на JavaScript, то поисковый бот не сможет распознать их, а значит обработать и добавить в кэш поисковой системы. Чтобы проверить кэш страницы, нужно добавить к ней cache: и просмотреть текстовую версию:

- Неправильный ответ сервера на нужные страницы. Страница, доступная для индексации, должна отдавать код ответа сервера 2хх. Если этого нет, не будет и индексации. Для поисковых ботов каждая группа ответов сервера дает указания, что нужно делать:

3хх означает, что нужный контент расположен по другому адресу;

4хх — страница не доступна;

5хх — проблема с сервером;

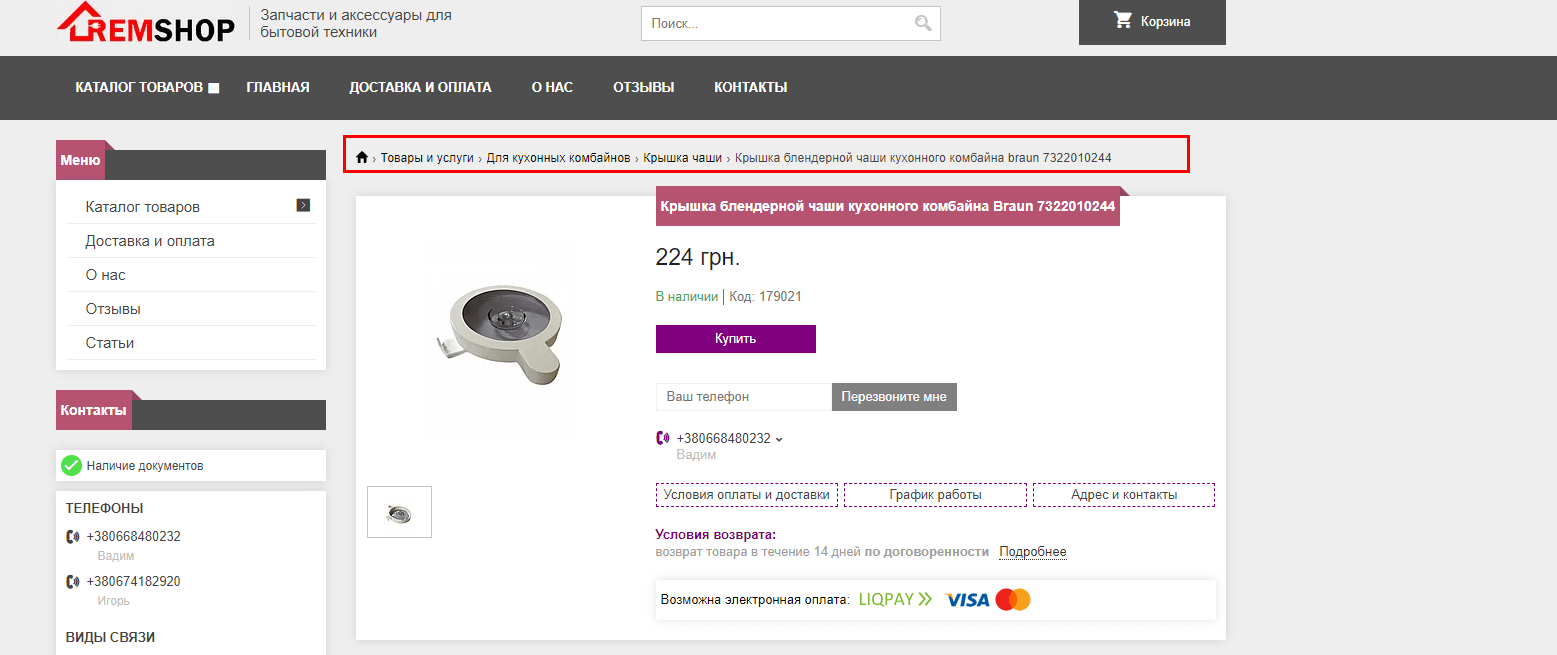

и только группа ответа сервера 2хх означает, что страница доступна по текущему адресу, а значит ее можно сканировать и индексировать. Следовательно, если сервер дает неверный код ответа нужной страницы, то страница не попадет в индекс. - Большой уровень вложенности. От вложенности зависит приоритетность страничек при индексировании поисковыми ботами. Чем больше уровень вложенности, тем меньше у нее приоритет: если вы создали новую страницу или новую категорию, но для того чтобы до нее добраться пользователь должен сделать более 3-х кликов — скорость индексации такой страницы будет не высока. Например: https://remshop.com.ua/p1007251549-kryshka-blendernoj-chashi.html

- Зайти на сайт.

- Перейти в категорию «Для кухонных комбайнов».

- Далее — на подкатегорию «Крышка чаши».

И только после этого можно будет перейти на нужную карточку товара. Согласитесь, не быстро.

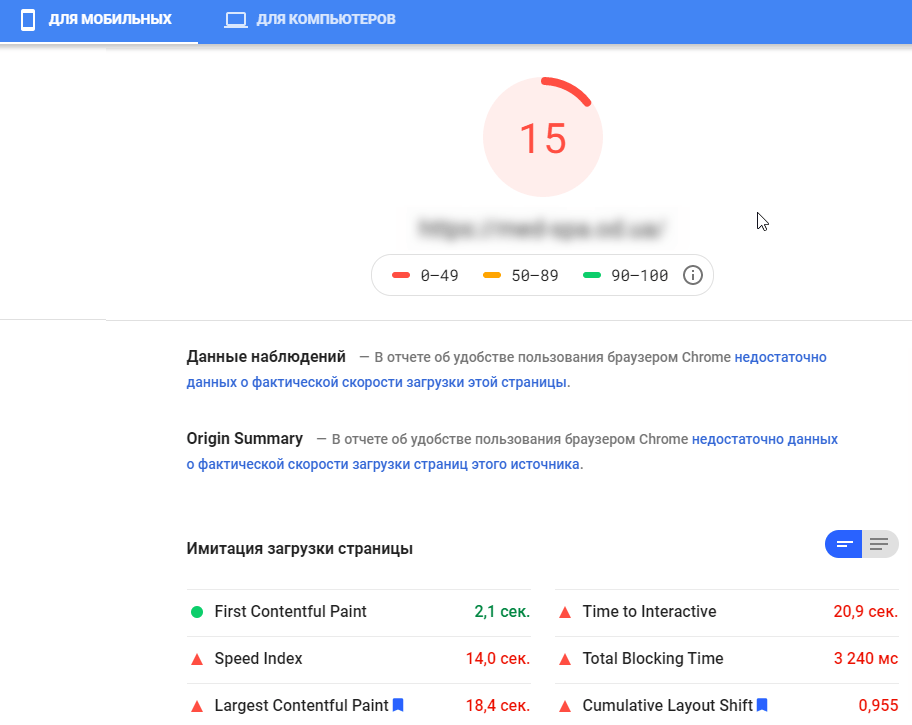

- Медленная скорость сайта. Скорость загрузки страниц условно состоит из трех составляющих:

- скорость загрузки контента;

- скорость загрузки изображений;

- скорость ответа сервера.

Чем меньше у вас размер контента, изображений и выше скорость загрузки сервера, тем быстрее бот просканирует страницу и добавит ее в индекс.

- Отсутствие мобильной версииКазалось бы, причем тут мобильная или адаптивная версия сайта к скорости индексации страниц поисковой системой. Но с 1 июля 2019 года поисковая система отдала приоритет мобильному контенту. Если страницы отсутствуют в мобильной или адаптивной версии вашего сайта, то поисковая система их может никогда не увидеть.

- Не регулярное обновление контента сайта. Частота обновления контента сигнализирует поисковому боту о ее регулярности. Если на сайте давно ничего не публиковалось или не добавлялись новые товары, то робот не будет ставить в приоритет сканирование и индексирование вашего сайта. Например, вы создали интернет-магазин, наполнили его товарами, контентом и всеми необходимыми данными. Тут можно подумать, что работа над сайтом закончена и нужно просто акцентировать на ссылочном профиле. И вот вы регулярно расширяете его, а результата нет. В чем же проблема? В том, что сайт без постоянного обновления контента (ассортимента), кажется поисковому боту «мертвым», а следовательно — время тратить на него не стоит.

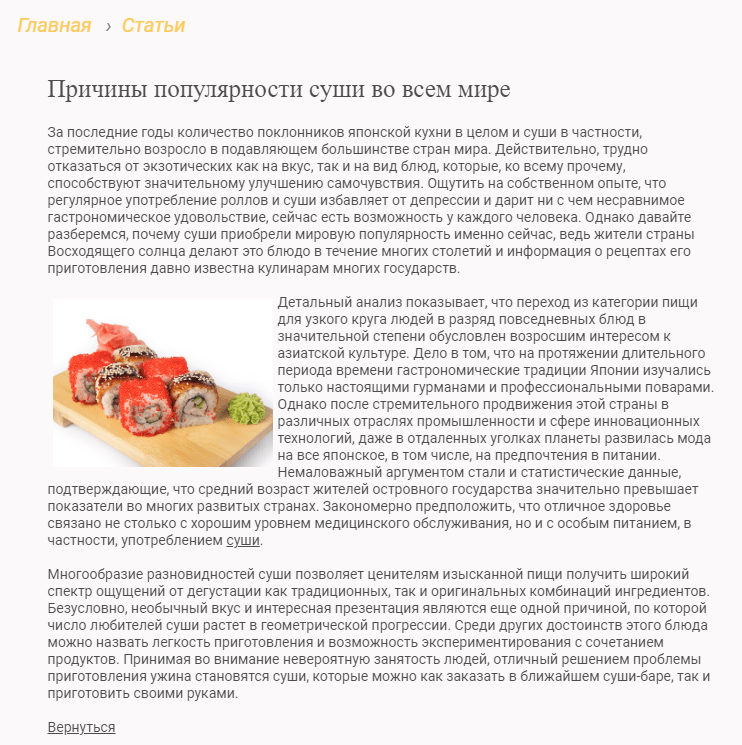

- Отсутствие внутренней перелинковкиПереход по внутренним ссылкам способствует ускорению индексации новых страниц. Чем больше линков ведет на страницу, тем больший вес она приобретает, то есть становится более значимой для поисковых систем. Например, на эту страницу ведет только одна ссылка из перечня статей: http://eco-food.com.ua/articles/sushi-is-popular/

Как узнать, что сайт плохо индексируется

Способ №1

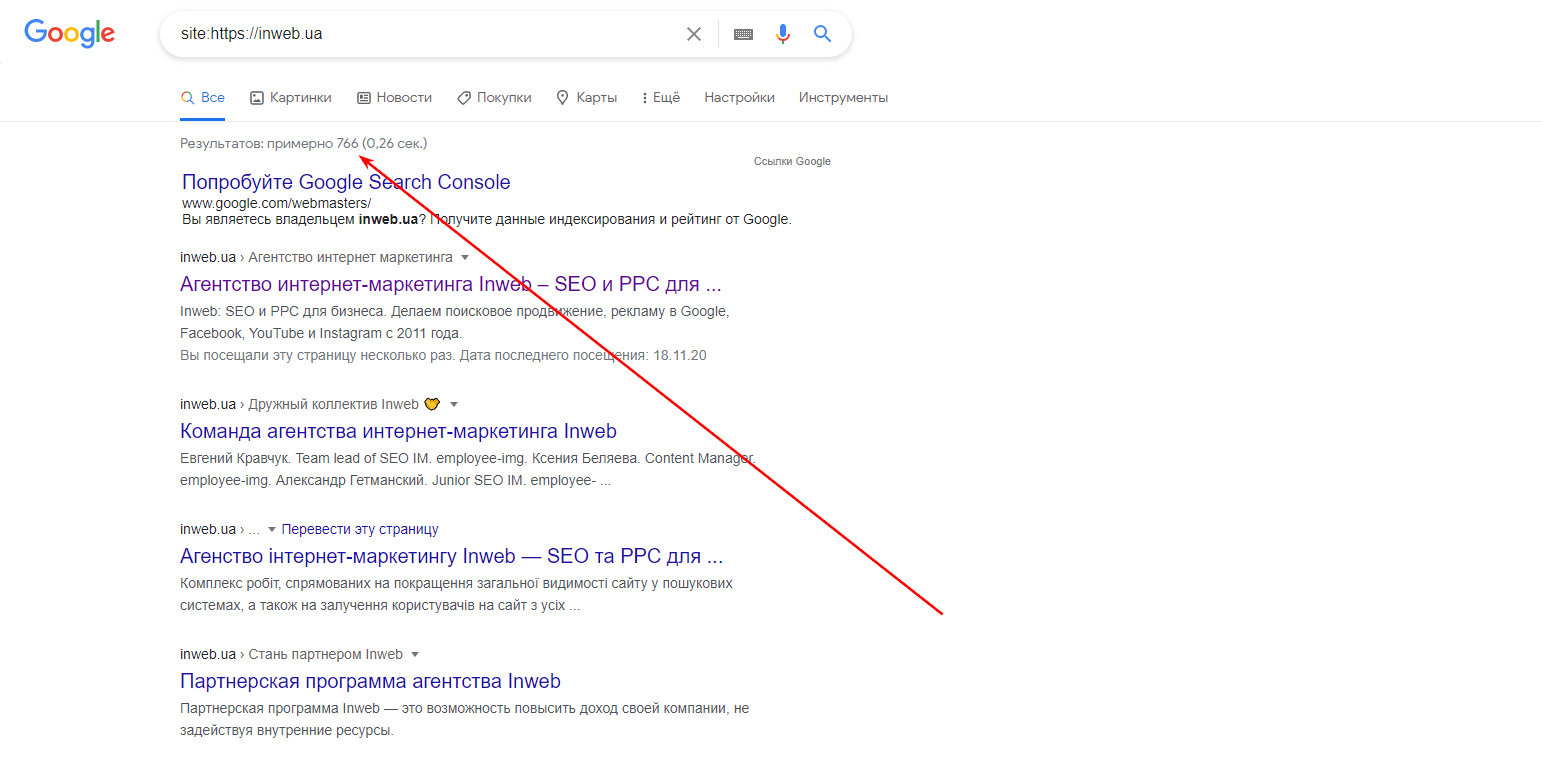

В админ панели смотрим общее количество страниц вашего сайта, а затем в поисковой строке к домену добавляем site: Пример: site:https:/домен.org

Под поисковой строкой вы увидите количество результатов, которые нашла поисковая система в выдаче с вашим доменом. Далее нужно сделать сравнение количества страниц в админ панели и количеством страниц в выдаче. Из разницы делаем вывод, сколько страниц еще не проиндексировано.

Способ №2

Сравниваем количество страниц с админ панели с данными из Search Console.

Пример: Всего проиндексированных страниц в Search Console:

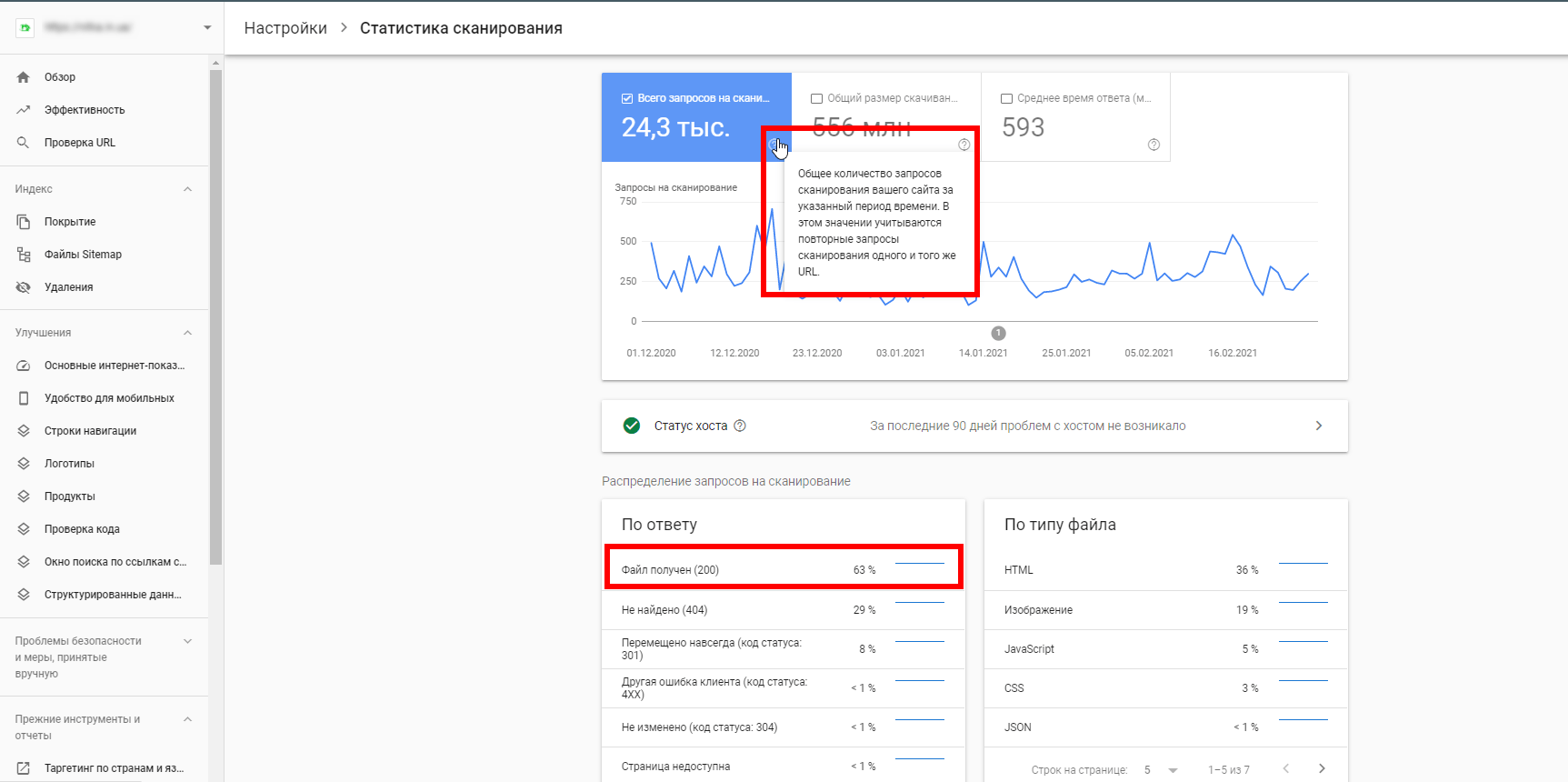

Также можно посмотреть отчет “Статистика сканирования”

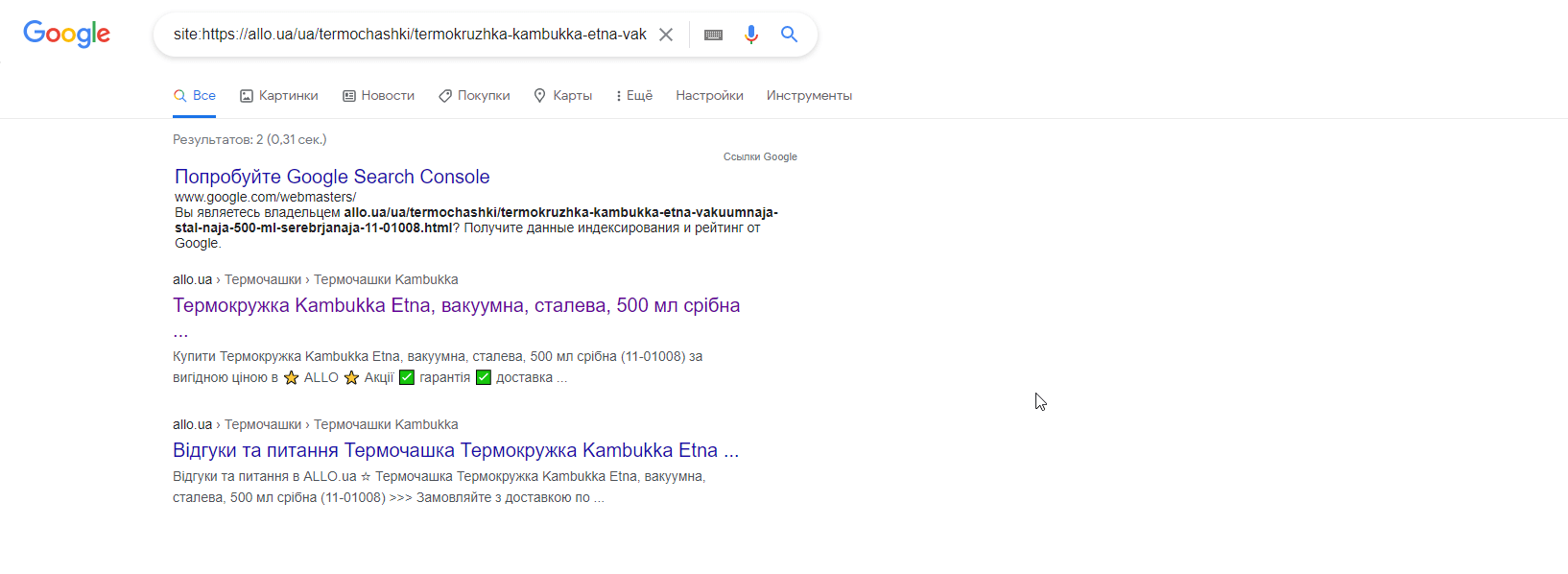

Способ №3

Можно посмотреть, есть ли конкретная страница в выдаче, используя тот же алгоритм, что и в способе №1. В этом случае нужно добавить site: к конкретному url-адресу. Пример:

12 методов ускорения индексации сайта

Подытоживая выше описанное, мы подготовили 12 действенных методов для улучшения индексации сайта Google.

- Обновление текущего контента. Один из способов привлечь поисковых ботов — это регулярное обновление контента на вашем сайте. Обновление контента может происходить путем переписи старого контента или его отдельных частей, например, за счет написания новых отзывов на старые страницы сайта.

- Добавление нового контента. Добиться привлечения внимания поисковых ботов к вашему интернет-ресурсу можно путем добавления нового контента на сайт. Для этого можно регулярно писать новые статьи на блог, добавлять новые товары, категории или информационные страницы.

- Отсутствие дубликатов и мусорных страниц. Как мы писали выше, на сканирование каждого сайта выделяется n времени поискового робота. Отсутствие дублей и/или мусорных страниц сайта увеличит количество времени поисковых ботов на сканирование нужных страниц. Как опередить, то что на сайте есть мусорные или дубли страниц? Начните с самого простого: проверьте корректность оптимизации страниц пагинации, фильтров и сортировок на сайте. Проверьте доступность страниц с /, www и без. Если у вас сделана данная оптимизация, просканируйте сайт специальными SEO-программами, например Netpeak Spider или Screaming Frog, обратите внимание на дубли метатегов.Страницы, оптимизированные под одинаковые запросы, также являются дублями в «глазах» поисковой системы.

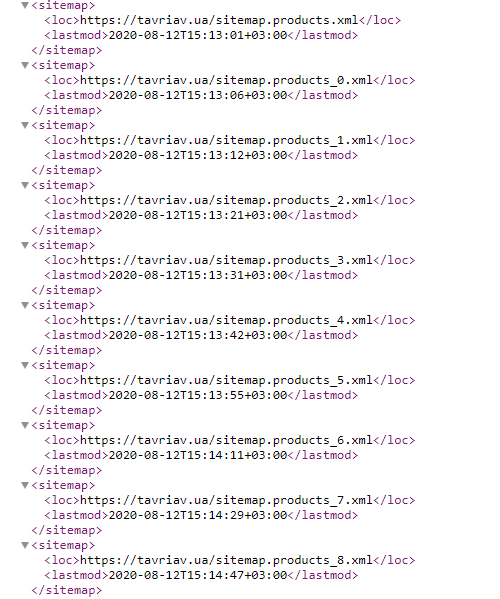

- Создать корректный и автообновляемый Sitemap.xml.Для ускорения индексации сайта, создайте корректную xml-карту и добавьте ее в файл robots.txt. Она будет, своего рода, навигатором по вашему сайту для поисковиков. А добавления в нее Last-Modified укажет ботам дату последнего обновления конкретной страницы и он будет сканировать страницы с новым контентом быстрее.

- Внешние ресурсы. Размещение ссылок на сторонних ресурсах или линкбилдинг не только помогает увеличить ссылочный вес сайта в целом или конкретной его страницы, но и привлекает поискового бота для улучшения индексации. Несколько способов размещение ссылки на ваш сайт на сторонних ресурсах:

- форумы;

- рейтинги;

- статьи;

- справочники;

- отзовики.

В текущей рекомендации важно выбрать качественные интернет-ресурсы с хорошими показателями, такими как посещаемость площадки, количество входящих и исходящих ссылок, основные ключевые слова ранжирования сайта и принадлежность к региону, в котором вы продвигаетесь.

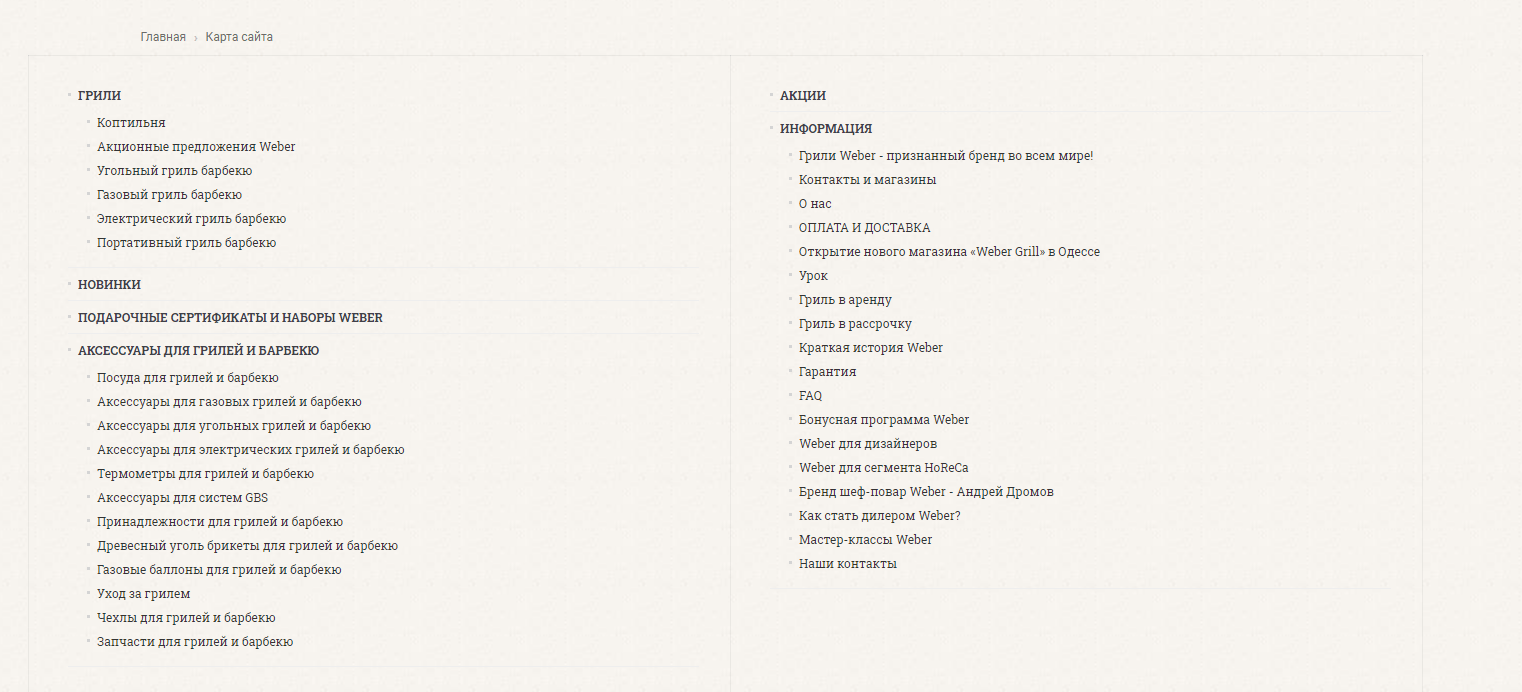

- HTML-карта сайта для категорий, а также для информационных страниц.Карта сайта в формате HTML — это, своего рода, каталог всех разделов сайта с категориями и подкатегориями, размещенных в соответствии с их иерархией. Наличие html-карты сайта показывает поисковой системе, какие страницы являются основными и уменьшает уровень вложенности для подкатегории.

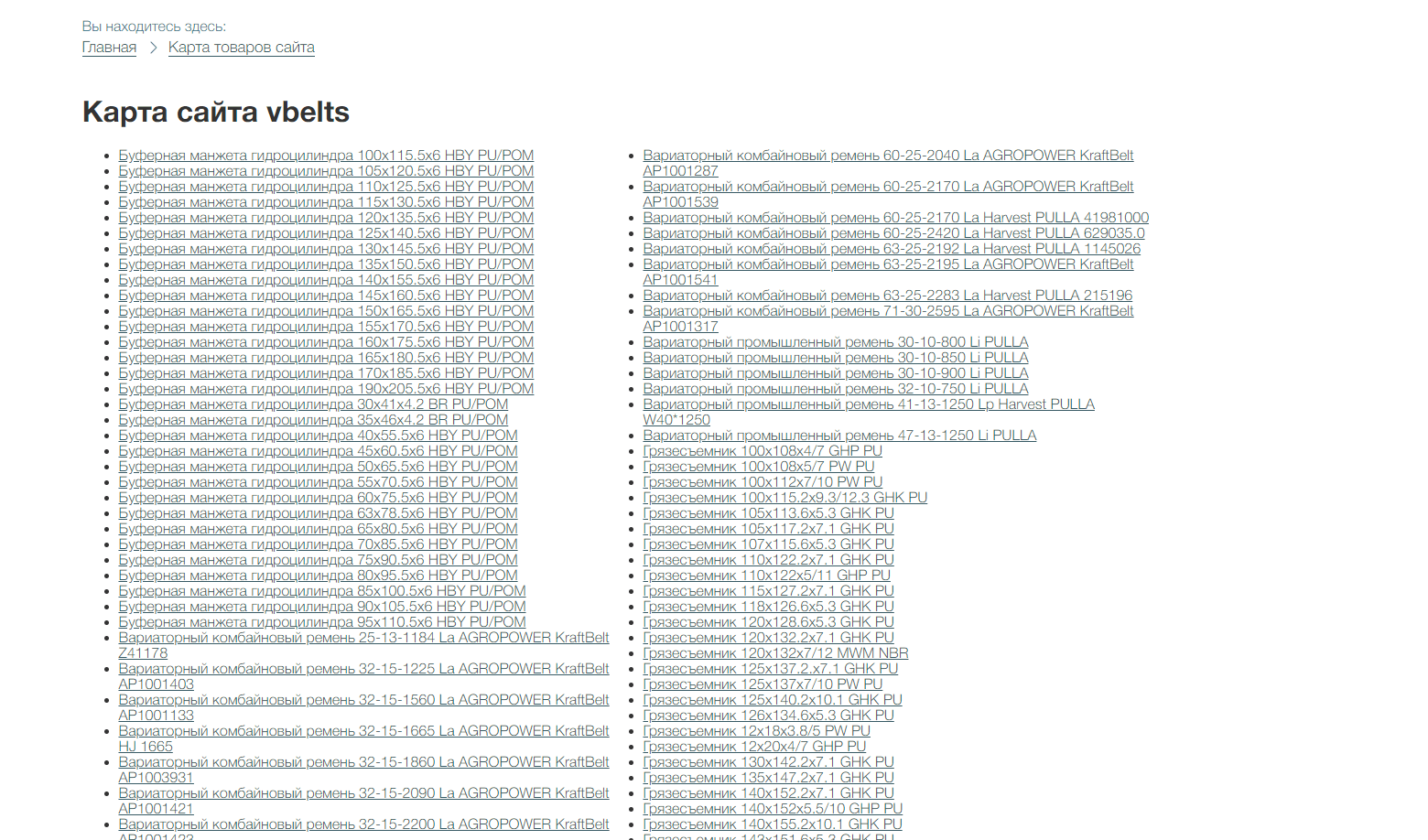

- HTML-карта сайта для карточек товара.Этот способ улучшения индексации хорошо подходит для больших интернет-магазинов: все карточки с товарами находятся в одном месте и являются, своего рода, путеводителем для поисковой системы по ассортименту.

- Хлебные крошки. Элемент интерфейса в веб-сайтах, показывающий путь от начальной страницы до того уровня, который в данный момент просматривает пользователь. Хлебные крошки являются элементом дополнительной линковки, которая в целом влияет на улучшение индексации.

- Выпадающее меню. Как быстро бот доберется до нужной страницы, зависит от уровня вложенности. Лучший результат вложенности страниц — не более 2-3 кликов. С этой целью многие веб-ресурсы создают выпадающие меню, в которое выводятся все основные ссылки на разделы и категории.

- Перелинковка по характеристикам на карточках товаров. Ссылки в характеристиках на карточках товара, ведущие на соответствующие категории или подкатегории, являются элементом дополнительной линковки, которая влияет на улучшение индексации.

- Ссылки в контенте. Чтобы поисковый бот быстрее зашел на новые страницы сайта, поставьте ссылки с уже проиндексированных страниц на новые. Проставленные ссылки в контенте должны вести на релевантные страницы категорий.

- Мобильная или адаптивная версия сайта. Как уже говорили, если страницы отсутствуют в вашей мобильной или адаптивной версии, то поисковая система их может не увидеть. Убедитесь, что все рекомендации, описанные выше, доступны в мобильной или адаптивной версии сайта. Если это не так, начните работать над своей индексацией именно с этого пункта.